La vidéo du jour parle de la créativité des IA, vue dans le contexte des jeux !

Pour ceux qui voudraient aller plus loin, quelques compléments d’usage.

Le MinMax

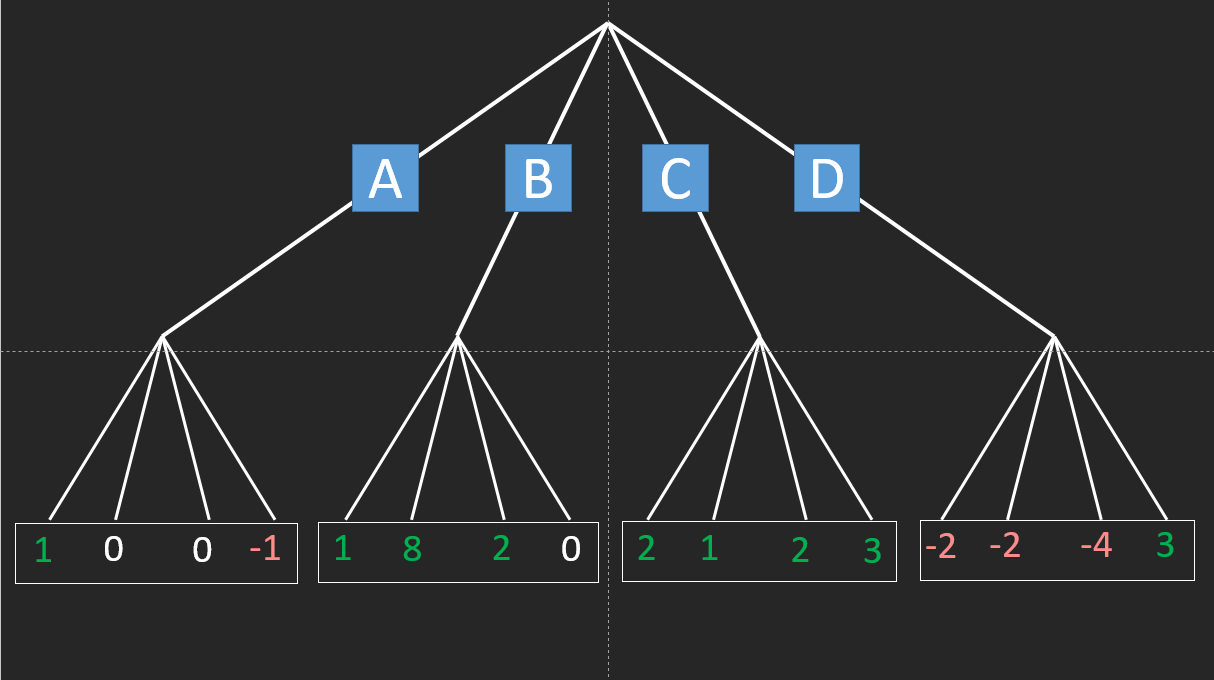

Un premier point que j’ai passé sous silence pour rester simple, c’est la façon dont on décide du « meilleur » coup une fois qu’on dispose de toutes les évaluations. Pour vous l’illustrer, voici une petite énigme.

Imaginez que j’aie 4 coups possibles, A, B, C et D, et que chacun de ces coups puisse appeler 4 réponses. Supposez que les résultats de l’évaluation des 16 positions résultantes soient les suivants, quel coup dois-je choisir ?

Si vous avez répondu « B » car c’est le coup qui mène à la position la plus intéressante (+8), vous êtes tombés dans le piège classique ! En effet il faut partir du principe que si on cherche à maximiser son score, l’adversaire lui a l’objectif inverse. Donc si il n’est pas plus bête que nous, il cherchera toujours à jouer la meilleure réponse (et donc si on joue B il jouera sa 4e option et le score sera 0).

La bonne réponse est donc C, car si l’adversaire joue son meilleur coup on sera à +1, ce qui est le mieux qu’on puisse espérer.

Ce petit exemple illustre le principe du MinMax, c’est-à-dire qu’on cherche le coup qui permet de maximiser son score sachant que l’adversaire va le minimiser.

Sur la manière de chercher dans l’arbre

Ma vidéo suggère qu’un algorithme comme celui qui tournait sur Deep Blue fait une recherche exhaustive dans l’arbre de façon totalement stupide. En réalité ça n’est pas si bourrin que ça.

Un simple petit calcul montre que si Deep Blue voulait chercher de façon exhaustive avec 12 coups d’anticipation, il faudrait \(20^{12}\) évaluations, soit 4 millions de milliards. Même à 200 millions d’évaluations par secondes, cela fait longtemps à réfléchir.

Deep Blue était en fait basé sur une technique classique appelée « L’élagage d’arbre alpha/beta », qui permet d’éviter de visiter des branches dont on sait qu’elles n’amélioreront pas le meilleur résultat qu’on puisse espérer. Stockfish fonctionne sur un principe similaire.

Sur la base de données utilisée par AlphaGo

Il semble que j’ai fait une erreur ou du moins une exagération concernant la base de données utilisée par AlphaGo pour s’entrainer (version « Apprentissage supervisé », celle qui a battu Lee Sedol).

En effet la base est constituée de parties jouées par des joueurs 6e à 9e dan (que j’ai appelé de façon informelle « des grands maitres du go ») et a été extraite de la base online KGS. Or j’ai l’impression qu’il y a une ambiguïté entre la notion de dan « amateur » et de dan « professionnel ». Et j’ai l’impression que la base KGS référence plutôt des parties amateurs.

Quelque part, c’est plutôt encore mieux pour AlphaGo, qui semble avoir appris en utilisant des données qui ne sont pas uniquement des parties de joueurs de classe internationale.

D’ailleurs c’est en fait un peu plus compliqué que ça puisque l’entrainement du réseau chargé de faire l’évaluation a bénéficié aussi d’apprentissage par renforcement.

Le fameux 37e coup

Quelques précisions concernant ce fameux coup. Je ne joue pas au go donc je n’ai clairement pas le niveau pour expliquer en quoi ce coup était inattendu. Mais il semble que généralement pour ce type de coup (appelé en anglais « shoulder hit ») qui consiste à se mettre en diagonale d’une pierre adverse, on se place sur la 3e ou la 4e ligne suivant qu’on veuille jouer défensif ou agressif. Mais semble-t-il, « jamais » sur la 5e ligne.

Alors en fait c’est plus compliqué que ça, et ça n’est pas le propos ici. Des « shoulder hits » sur la 5e ont l’air tout à fait possible, mais apparemment pas dans la situation qui se présentait à AlphaGo à ce moment là.

AlphaGo, AlphaGoZero et AlphaZero

Pour les besoins de la simplification de l’exposé, j’ai fait un raccourci dans ma présentation. Il y a eu en réalité (au moins) 3 versions de l’algorithme :

- AlphaGo, qui a battu Lee Sedol

- AlphaGo Zero, la première version fonctionnant purement en apprentissage par renforcement, mais uniquement pour le go.

- AlphaZero, fonctionnant aussi bien pour le go, les échecs ou le shogi.

Je n’ai pas évoqué AlphaGo Zero, la version intermédiaire. Et en fait c’est elle qui a battu « Alpha Go Lee Sedol » par 100 à 0.

La différence entre AlphaGo Zero et AlphaZero, est que le premier exploite quelques spécificités du Go pour se simplifier la vie, ce que les spécialistes appellent du « domain knowledge », par exemple l’existence de symétries sur le plateau. Le fait de donner du « domain knowledge » permet de réduire la complexité de l’apprentissage par renforcement (et donc de l’accélérer), mais au prix d’une perte de généralité et de « pureté », puisqu’on aide l’algorithme en lui donnant des infos en plus.

AlphaZero est vraiment la version « pure », on ne lui donne aucun domain knowledge, vraiment juste les règles et rien que les règles. Il est un peu plus long à entrainer que la version précédente, mais l’avantage est qu’il marche aussi pour d’autres jeux abstraits. (Et au go il est légèrement supérieur à AlphaGo Zero).

Et les autres jeux vidéo ?

J’ai hésité dans cet épisode à parler des applications de l’IA à d’autres jeux, notamment vidéo. J’aurai pu par exemple évoquer DOTA2 ou StarCraft. Apparemment j’ai bien fait de m’abstenir, car à l’heure où j’écris ces lignes DeepMind a annoncé qu’ils allaient faire une grosse annonce concernant StarCraft, le jour qui suit la publication de la vidéo. Donc à suivre !

43 Comments

Bonjour ! Chouette vidéo comme toujours !

Une question me vient à l’esprit à propos du match ayant opposé AlphaZero et Stockfish. Comment se fait t-il que le score ne soit pas de 1000 à 0 ou de 1000 matchs nuls ?

Cela implique t-il qu’il y ait une part de hasard dans le choix des coups de ces algorithme ? Car si les 2 joueurs avaient des réactions déterministes suivant les fonctions d’évaluation, toutes les parties seraient finalement identiques non ?

Je ne sais pas exactement la façon dont est concçue AlphaZero, mais dans les algorithmes utilisés par les réseaux de neuronnes à renforcement, il y a une part de hasard du fait de l’exploration. De façon simplifiée, le principe consiste à explorer aléatoirement de nouvelles branches de l’arbre des possibilités et d’essayer de les évaluer. Cela permet de trouver des coups à fort potentiel.

Stockfish utilise la méthode de Monté-Carlo qui fait appel au hasard. Les évaluations pour une même position ne sont par conséquent jamais les mêmes.

Quant à AZ, il fait peut être appel au nombres aléatoires pour s’entraîner, mais une fois qu’il a trouvé son modèle, les réponses seront toujours identiques pour une position donnée.

Autrement dit une partie Stockfish vs Stockfish ne se reproduira pas et une partie AZ vs AZ se reproduira.

Peut-être qu’AlphaZero (et Stockfish?) modifie sa base après avoir joué chaque partie, auquel cas, même si les réactions sont déterministes, cela peut influer sur les coups joués. Typiquement, si un humain ou un programme vient de perdre, il ne devrait pas réessayer de rejouer les mêmes coups. D’autre part, le parallélisme massif introduit forcément une part d’indéterminisme puisque les conditions physiques ne sont pas exactement les mêmes.

Salut.

identique ou cyclique ou ni l un ni l autre.

I intuition n est pas une preuve.

Quant au hasard il reste a prouver aussi son existence.

Merci.

Salut,

En fait, j’imagine que c’est juste que dans l’arbre de tous les jeux possibles, il y a de nombreuses parties qui se termine par un nul (PAT). L’algorithme à défaut de pouvoir attaquer protège son roi, ce qui conduit à ce type de fin.

Si on prend l’exemple d’un jeu beaucoup plus simple comme le morpion, il est certain que le résultat d’un match entre une IA à réseau de neurones et une autre déterministe (la faible combinatoire de ce jeux permet cela) conduirait à un fort taux de nul par exemple.

Bonne journée à vous tous.

Bonjour,

Les deux algorithmes utilisent la méthode de Monte-Carlo, donc le hasard rentre en compte dans l’exploration de l’arbre de jeu, ce qui explique que les choix ne sont pas déterminés.

La différence principale entre ces algorithmes est la manière dont ils choisissent explore préférentiellement certaines branches plutot que d’autres (ou pour simplifier « coupe » des branches dans l’arbre de jeu). Stockfish va évaluer les positions d’une manière écrite à la main par des humains, en fonction de leur compréhension des échecs, tandis qu’Alphago utilise un réseau de neurones, qui s’est entrainé « tout seul » à évaluer les positions.

Bonjour,

Non justement c’est là que beaucoup de personnes se trompent, Stockfish n’utilise contrairement à AlphaZero pas le Monte-Carlo, qui utilise lui en grande partie le hasard, il utilise la recherche alpha-bêta, qui n’utilise pas de hasard, simplement un facteur d’évaluation pour éliminer des lignes à ne pas analyser (même s’il arrive que cela échoue, mais dans des positions complètements improbables). Là où AlphaZero a montré sa supériorité, c’est sur ce qui se nomme le jeu positionnel, ce qu’on pourrait comparer à un jeu sur le long terme, mais la victoire d’AlphaZero n’en est pas vraiment une car beaucoup d’éléments tournaient au désavantage de Stockfish (cadence, puissance de calcul de la machine sur laquelle il fonctionnait, absence d’arbre d’ouvertures et de tables de finales…).

Bonjour,

Je vous remercie pour votre travail et votre contenu de grande qualité. Le machine learning est bien évidemment extrêmement interessant et ouvre de nombreuses questions sur le futur. Je ne peux que me réjouir que vous abordiez ce sujet en profondeur. J’aime également particulièrement la video d’un autre créateur que vous devez connaitre (CGPGrey) et sa vidéo intulée « Humans need not apply).

Cependant, je suis également très intéressé par le « Human learning », et j’en profite pour vous remercier vous et tous les autres pour votre fantastique initiative « Billes de Sciences » que je suis avec enthousiasme. Etant un futur papa, je m’interroge comme beaucoup sur la meilleure manière d’interesser mes enfants aux sciences et à l’apprentissage en général. Etant vous-même papa, je serai très interessé d’entendre votre avis et expérience en la matière.

Je vous remercie encore pour tout votre travail et je vous souhaite une bonne continuation.

Hugo

Bonjour Hugo,

Je lis, tardivement, votre commentaire et rebondis sur appel aux pères sur la manière d’intéresser les enfants aux sciences.

Moi même père d’une fille qui « va » sur ses 50 ans (!) je regrette, avec mon épouse, de ne pas avoir soigneusement noté sur un petit carnet (au crayon pour que l’écriture dure) les dates et les question auxquelles elle nous a soumis, dès qu’elle a commencé à maitriser le langage, et jusqu’à 8/10 ans.

La façon dont le cerveau d’un enfant construit sa compréhension du monde est stupéfiant.

Je pense, pour répondre à votre interrogation, que l’exercice que je vous propose est de nature à stimuler de nouvelles questions et donc à progresser dans l’intérêt aux sciences et plus généralement à réfléchir …

De plus ce recueil pourrait, peut-être, au moment de l’adolescence, aider à maintenir le contact en reprenant ces occasions d’échange.

Je vous souhaite de très bons moments avec votre enfant.

Je vais laisser le même commentaire que j’ai laissé sur la vidéo youtube pour le coup :

Bonjour, très bonne vidéo comme toujours ! je tenais juste à souligner certains points par rapport à ce que tu as dis :

Il faut savoir que la partie entre l’AI et de Google et Stockfish était biaisé, quand on lit le papier de recherche publiée par DeepMind on se rend compte de plusieurs aspects (sur lesquels le créateur de Stockfish s’est exprimé):

– Gigantesque différence de puissance allouée entre les deux programmes : Google avait une machine à plusieurs millions de dollars, tandis que Stockfish un simple ordinateur commercial.

– Il y’avait une limite de temps attribuée pour jouer, hors l’approche stockfish a besoin de ne pas avoir cette limite de temps pour pouvoir performer à son réel potentiel.

Je te redirige vers cet article pour plus d’informations là dessus : https://www.chess.com/news/view/alphazero-reactions-from-top-gms-stockfish-author

et bien sur le papier redigée par l’équipe deepmind pour appui : https://arxiv.org/pdf/1712.01815.pdf

Cordialement.

(Pour les intéréssés par le domaine de l’apprentissage par renforcement je conseille les travaux de la team OpenAI qui font des merveilles avec et tiennent un blog sur leurs analyses et prouesses réalisés sur des jeux compétitifs bien plus complexes comme Dota 2 : https://openai.com/ )

Vous faites une grosse confusion Ramoul. La puissance que vous évoquez est nécessaire uniquement dans la phase d’apprentissage. Le nourrissage du réseau de neurones consomme énormément de ressources. Quand il joue contre un adversaire, le réseau de neurones peut parfaitement jouer sur une toute petite machine ! D’ailleurs, contre Stockfish, jusqu’à 10 fois moins de temps alloué, il a littéralement écrasé son adversaire.

La question n’est pas en fait de savoir « ki cé ké le plus fort? ». On s’en fiche. Tous les joueurs d’échec ont pu voir dans les parties produites (mais peut-être n’êtes vous pas vous même joueur d’échecs) que AZ joue d’une manière complètement différente de celle des autres algorithmes. Souvent, on commente un coup en disant: Ah c’est un coup d’ordinateur ! Sous-entendu, un coup que l’on ne comprend pas. Quand AZ joue: On comprend ! On comprend parce que le « génie » d’AZ ne se déploie pas dans un super calcul de variante mais dans le déploiement d’une stratégie: par exemple avancer un pion isolé en h7 pour prendre le contrôle de cases stratégiques à long terme. Ou, dans l’exemple donné par David Louapre dans la vidéo, mettre l’adversaire en zugzwang ( il n’a plus de coups. il est totalement paralysé). Tout ce que fait AZ, nous les humains le faisons…en moins bien. Lui ne fait pas d’erreur de calcul!

Une autre question que je n’ai pas évoqué dans un précédent commentaire est celui de l’avenir des championnats d’échecs d’ordinateurs: Car si AZ devait s’aligner, ce championnat n’aurait plus aucun intérêt. Un peu comme si on alignait Roger Federer dans un tournoi où tous les autres joueurs seraient au mieux classé à 15!

On pourra m’objecter qu’il suffira de mettre les IA en concrrence. (cf Leela chess) . Mais, en bonne logique, ces IA devraient aboutir au fil de leurs affrontements aux même conclusions et produire indéfiniment la même partie !

C’est bien cette phase d’apprentissage qui biaise tout. AZ apprend à jouer, c’est à dire qu’il modélise les échecs. Dans ces conditions, donnons à Stockfish la même puissance et le même temps d’analyse pour se constituer une base de coups.

En championnat de moteurs d’échecs, les premiers coups correspondent à un livre d’ouverture or là Stockfish n’en a pas eu accès.

Et comme Ramoul le dit, le temps alloué pour chaque coups est un gros handicap pour Stockfish qui optimise habituellement son temps.

Bref, ces parties font controverse et à juste titre.

@eric Donc le principe, c’est de comparer des techniques differentes mais si yen a une qui est clairement meilleure, c’est injuste.

Pourquoi faut toujours que les communistes viennent faire chier dans tous les domaines?

Ah oui j’aime bien ces commentaires qui ramènent aux conditions du match pour prouver que Stockfish n’a pas vraiment été vaincu. Tu aurais aussi pu préciser l’absence d’arbre d’ouvertures et de tables de finales qui tournait également au désavantage de Stockfish.

Sinon, des spécialistes en psychologie cognitive ont déjà créé des intelligences artificielles qui tentent de modéliser la créativité humaine, afin de mieux la comprendre. Il y a tout un domaine dédié à cela : la créativité computationnelle (computationnal creativity, en anglais). M’est d’avis que ces programmes doivent déjà être plus intelligents que les approches brute-force mentionnées dans la vidéo… D’ailleurs, les approches mentionnées dans la vidéo ne font pas partie de ce domaines : ils ressemblent plus aux programmes dédiés à la résolution de problèmes, presque tous similaires à ceux utilisés par Herbert et Simon pour modéliser l’expertise.

Et qu’en est-il du Poker ? J’ai lu quelque part qu’une I.A avait battu plein de super joueurs lors d’un tournoi ! Le Poker a quand même cette part de bluff ou peut-être est-ce quand même un jeu fermé que l’I.A peut totalement parcourir ?

La limitation de temps (1min par coup) est un critère déterminant, qui à mon avis biaise le résultat. Stockfish fait des calculs profonds et a besoin de temps pour déterminer les meilleurs coups.

Alfa zéro est vraisemblablement plus fort pour sélectionner les coups candidats rapidement, mais on ne sait pas ce que ça donnerait avec une limite de temps adaptée à stockfish.

Je confirme qu’il y a une différence entre les dans amateurs et les dan professionnels. D’ailleurs, généralement, on note k pour kyu, d pour dan et p pour dan professionnel. On peut à peu près considérer que 7d ~= 1p

Bonjour,

J’apprécie ce que vous faites et qui vous êtes !

Moi c’est l’humain, l’humanité qui m’intéresse, aussi la science, le « SAVOIR » humain, mais à condition qu’elle, ou qu’il, serve réellement l’HUMAIN, le principe d’ HUMANITÉ, et non qu’elle ou qu’il, l’exploite en tremes de moyen, l’humain devenant un moyen utile comme un autre ! ! Donc , je m’interroge! Comment l’artificiel peut-il être « intelligence »; il peut-être de conception intelligente mais pas « intelligence » ? Il n’y a là que de l’ingénierie mécanique et comme vous dites des bourrins de calculateurs ! Tout comme le savoir humain, l’intelligence est une particularité humaine qui implique de l’intentionnalité (et laquelle ?),aussi de la probité ! Un savoir humain, une intelligence humaine qui doivent être passés au crible du « principe d’humanité »; qui doit être qualifiée en terme d’entendement : d’Ontologie, de Déontologie, d’Éthique et d’Altérité! !

Le danger avec le SAVOIR, c »est qu’il se substitue à la matière, la manipule à l’extrême en physique, ou au paroxysme en matière de métaphysique humaine; comme par exemple en économie ! Qu’est-ce que l’économie? Réponse : une science ! Quid de la pratique sociétale, ce quasi état de nature sociétal qu’est l’économie? Il n’y a plus de « raison », pas de finalité, que du « rationalisme », que des moyens à mettre en œuvre que se servent de l’humain, alors qu’ils devraient, au contraire, servir l’humain ! Sommes nous plus intelligents avec notre pléthore de savoir rationalo technoscientiste ? Non, il semblerait même que nous soyons toujours au fond de la caverne avec les ombres qui s’agitent et même de plus en plus ! Je ne suis pas contre la technologie, que j’estime utile et nécessaire à l’humain pour évoluer, à condition de réellement évoluer, progresser en termes d’Humanité et non régresser. Concernant la physique quantique, dont je ne suis pas un spécialiste, je ne retiens qu’une chose c’est que tout est complexité, que ce soit en matière de « physique » comme de « métaphysique » humaine:que la simplification au simplisme n’a pas de sens. Nous avons besoin d’une approche plus « pertinente » qui permette la connaissance complexe, comme l’approche « écosystémique », ceci, en lieu et place d’une connaissance basée sur l’individualisme méthodologique vouée au simplisme de la chose pour la chose, de la chose imbécile; et à la manipulation que ce simplisme permet !

Je retiens les « acquits intellectuels du XX è siècle » qui limitent la connaissance tant dans le domaine du raisonnement que dans celui de l’action, avec le principe d’incomplétude de Gödel et Chaitin, celui d’incertitude d’Heisenberg, qui sont issus de la « physique quantique » , et aussi celui d’impossibilité d’Arrow, qui vient de la sociologie. Je pense aussi aussi au principe cognitif de Pascal (Toute chose étant…) qui était un précurseur de l’écosystémie et même initiateur de la pensée quantique. Cordialement

en effet je dirais même plus en effet https://www.nextinpact.com/brief/starcraft-ii—l-intelligence-artificielle-alphastar-met-une-deculottee-a-deux-joueurs-pros-7488.htm

L’IA n’est pas créative. Elle répond à une logique statistique. Quand elle apprend elle modélise un système avec des données en corrélant ces données selon une optimisation.

AZ à appris avec des parties existantes, mais aussi en jouant des parties nouvelles. Qu’est-ce qui donne l’apparence d’une créativité ? Des coups non académiques ?

Et bien cela tient du fait que l’IA corrèle des données selon ce qui est et que nous sommes incapable de modéliser les innombrables variantes tant elles sont nombreuses, parce ce que nous ne connaissons pas toutes les corrélations, bien que nous connaissions quelques principes (occuper le centre, développer ses pièces…).

Il en va de même pour Google qui arrive à réduire la quantité énergétique de 30% pour refroidir ses data-centers grâce à l’IA. Personne ne comprend pourquoi nos systèmes de régulation PID sont si peu efficaces. Qu’elles corrélations entre les grandeurs physique nous échappent ? Seul un programme de recherche scientifique pourrait résoudre ce mystère.

Est-ce pour autant que l’IA a fait preuve de création ? Non, elle a réussi à modéliser le réel selon des statistiques et n’a rien inventée.

Ah je ne suis pas d’accord. Au fond, notre cerveau a un fonctionnement assez similaire. En fait, je serais tenté de relier la créativité au phénomène d’émergence (le même qu’on retrouve dans la fourmi de Langton). Au final, même si on n’y comprend pas grand chose, il semblerait que notre cerveau marche sur des principes similaire (ok, c’est plutôt l’inverse vu qu’on s’inspire du cerveau pour créer les IAs). En gros, si on y réfléchie, pour l’humain, tout part d’une molécule qui a la capacité de s’auto-répliquer (l’ADN), et le reste sont des conséquences « logique ». on peut donc considérer que c’est une formidable créativité de la vie, du hasard que d’avoir donné émergence à des êtres de plus en plus complexes. Si on y réfléchie, avec les algorithmes génétiques, et même les réseau de neurones, c’est un peu ce même processus qu’on modélise, en accéléré car utilisant des heuristiques, et des intuition issues de notre propre connaissance.

Je pense donc que ces phénomènes sont assez proches. D’ailleurs, pour en revenir à la créativité au sens humain du terme, on observe que généralement, les plus grandes découvertes sont réaliser durant des thèses, d’où l’importance d’un œil nouveau.

Quand on fait son État de l’art et sa bibliographie, on fait finalement un peu ce qu’à fait AlphaGo : on regarde l’existant, on regarde ce qui a marché et ce qui n’a pas marché, on fait des liens, et on avance jusqu’à dépasser la connaissance actuelle.

Certes, ce ne sont que des probabilités et des nombres… Mais… Nous ne somme que des molécule, des atomes, et des particules élémentaire dont l’état peut… se représenter comme des nombre, et des probabilité, non ?

Moi, je trouve le coup 37 créatif. Pour le coup, Alpha-go aurait certainement passé le test de Turing sur cette partie 🙂

Quand l’homme invente, il fait d’abord abstraction du réel pour créer un modèle. Cela peut rester théorique ou être vérifié par les observations (par exemple les ondes gravitationnelles d’Einstein non validé de son vivant).

Quand la machine modélise, elle ne fait pas d’abstraction. Elle ajuste au mieux le modèle et ne ne cherche pas un modèle correct ou juste mais optimal. Le modèle est sujet à erreurs.

L’émergence numérique est une régression du réel et non une abstraction. Mais bien sûr l’émergence de la créativité humaine est sujet à polémique quant à savoir s’il y a une totale liberté, venue du néant, ou une destiné inconsciente. Mais cela est un autre sujet.

Hl037, la créativité selon moi n’est pas ce que vous décrivez. Par exemple, l’auteur de star wars a crée les sabres lasers qui sont impossibles à creer physiquement ( car la lumiere ne peut pas s’arrêter à l’extrémité du sabre) .Une IA ne pourra donc jamais créer le sabre laser de star wars. Sa créativité est donc extremement limitée, elle ne se base que sur son expérience réel et sur un nombre trés grand de possibilitées réelles mais non imaginaires impossibles. C’est là toute la difference.

L’Intelligence Artificielle type AlphaGo ou AlphaPlus n’a aucune capacité de création. Les coups inédits qui ont surpris Lee Sedol et les spécialistes sont le résultat d’une recherche heuristique (= quasi au hasard) sur le Goban grâce à l’algorithme de Monte Carlo.

L’apprentissage attribue une probabilité de victoire à chaque position envisagée. Cette probabilité est déterminée grâce à un grand nombre de parties (historique, jeu contre soi même ou autre possibilité). Nous sommes plus proche de la force brute que de la créativité.

L’Intelligence Artificielle d’aujourd’hui (ie faible) est construite sur la statistique. Par définition on ne peut aller au delà des données à l’origine de ces statistiques. La création en est exclue.

Jacques

En partie seulement d’accord. La machine n’a effectivement aucune notion de « création » (n’a aucun recul sur elle-même).

Mais ces algo permettent des découvertes (nouvelles approches pour la résolution de problèmes, nouvelles stratégies, etc.).

La créativité reste ici dans les mains de l’être humain. Mais on crée effectivement grâce à ces outils.

Autre aspect. Rien ne prouve (je crois ?) que nous ne fonctionnons pas (notre cerveau) sur des bases très similaires à ces programmes. Sans doute les puissances de calcul comptent et bien des choses sont encore à comprendre. Mais deux aspects:

– ces débuts de l’IA vont permettre un accélération forte de ces recherches

– dès que ces recherches permettront d’embrayer vers la « création d’un cerveau » (dans un esprit l’IA génère l’IA, bootstrap), les choses vont aller très vite

… mais c’est peut être encore pour les prochaines générations… nous verrons (ou pas) !

Le fonctionnement du cerveau humain est fondamentalement différent de celui de l’IA (faible).

Pour un cerveau humain, le concept « voiture » englobe les cabriolets, les SUV, les breaks, les vues de dessous, de dessus, les voitures miniatures. Pour l’IA, c’est grâce à des millions d’exemples que l’on fait le lien entre une suite de pixels et une suite de caractères notée « voiture » le tout étant associé à une probabilité.

L’IA (faible) est un traitement statistique et n’a pas accès à la conceptualisation. On attend ça avec l’IA forte dont l’avènement passe par la compréhension de la conscience dans le cerveau humain. Ce n’est pas pour demain, on ne sait par où commencer malgré plusieurs siècles de questionnement. On imagine difficilement les progrès en IA faible à base de statistiques nous y mener.

Bien cordialement,

Jacques

Si l’on entend par cerveau un système centralisé qui réagit à un environnement, l’électronique est déjà capable de le faire. Par contre un cerveau reptilien responsable de comportements primitifs assurant la survie d’une machine est autrement plus spéculatif. Seule l’évolution darwinienne le permet. Comment dès lors une machine pourrait-elle s’adapter si elle ne se reproduit pas ?

Quant à la spiritualité, c’est totalement illusoire. Notre conscience vient de l’extériorisation de la mort qui nous a extirpé du monde naturel. Comment ce qui ne fait pas parti de la nature pourrait-il passer de l’artificiel au spirituel ?

Ceci dit, l’artificiel peut s’auto-améliorer. Une IA peut apprendre d’une IA pour progresser. On peut même envisager des poupées russes d’IA mais cela serait hors contrôle. Déjà qu’avec l’IA classique l’homme ne comprend pas le pourquoi des choix de l’IA, une IA d’IA poserait la question du comment autrement plus problématique.

… mais j’ai omis de préciser que j’apprécie toujours autant la pédagogie et la richesse des vidéos de sciencetonnante ! Merci et continuez !

Jacques

Pour démystifier un peu: ce n’est « que » du calcul matriciel sur la base d’une architecture logicielle définie de manière appropriée à la typologie de problèmes à résoudre (et toutes les typologies de problèmes ne sont pas ou pas encore accessibles à ce type d’algorithmes).

Pourtant, ça reste « extraordinaire », « surprenant », .

A mon sens, si on parle de créativité, elle reste à l’humain, car nous sommes encore son démiurge pour le moment. Par contre, avant de vraies machines « intelligentes », nous aurons probablement toute une phase où ces programmes vont nous permettre de progresser (en tant qu’êtres humains) et mieux comprendre de nombreux sujets (exemple: recherche médicale, recherche spatiale, sciences dures, …).

C’est pareil avec Excel: on a tous lancé un calcul qui aurait été trop long à effectuer sur papier…

Ça reste cependant l’un des outils les plus élaborés jamais conçus, pas si complexe finalement mais rendu possible par les immenses puissances de calcul disponibles aujourd’hui (et nécessaires pour la phase d’apprentissage de ces programmes).

J’ai trouvé un article qui concerne les progrès de l’ IA pour le poker et le bridge :

https://www.lesechos.fr/08/10/2018/lesechos.fr/0302352861403_ces-jeux-qui-resistent-encore-a-l-intelligence-artificielle.htm

19:50. Ce n’est pas l’“IA” qui a trouvé la formule gagnante, c’est le programmeur qui a écrit du code pour identifier le mouvement qui permet de casser un maximum de briques. L’algorithme a “vu” qu’en envoyant la bille dans la partie supérieure permet de casser plus de briques et donc il y a une instruction dans le code du développeur de renvoyer la bille à cet endroit. Mais JAMAIS sans programmation par un humain cette acquisition n’aurait été possible. Donc ce n’est pas de l’intelligence, c’est juste de l’exécution IF… THEN.

Très bonne vidéo comme d’habitude, étonnant qu’elle arrive quelques jours avant la présentation d’alpha Star, l’IA de deepmind pour starcraft, il sera interessant de suivre son évolution voir si elle permettra une réel créativité dans le but de tromper l adversaire ou si elle ne développe qu’un jeu optimisé en maximisant la qualité de ses positions.

Pour avoir vu la présentation, malgré les progrès indéniable même en 1semaine (entre le premier et le deuxième match) il lui reste encore du chemin.

Excellente vidéo comme à l’accoutumé. Je pense que comme souvent la discussion autour de l’emploi à bon ou mauvais escient du terme « créativité » dépend surtout du signifié, de la définition, qu’on lui attribue et qui varie beaucoup d’une personne à une autre. Certains se contentent de voir dans la créativité la capacité à produire une solution originale qui suscite l’intérêt voire l’admiration, fût-elle la résultante fortuite d’un processus formel. D’autres estiment qu’il faut en plus que cette solution résulte d’une forme d’intentionnalité, de volonté, de quelque chose proche apparenté à la conscience. Ces derniers ne pourront donc par hypothèse jamais considérer qu’une IA faible soit capable de créativité. Il n’y a évidemment pas de bonne definition, le langage naturel étant approximatif et malléable, néanmoins la seconde définition a pour conséquence de transférer automatiquement la discussion sur le terrain du problème difficile de la conscience. Pour ma part, je pense que la biologie et la théorie de l’évolution permettent d’envisager une transition progressive et continue de la physique des particules au fonctionnement d’un esprit humain conscient de lui-même, les autres êtres vivants offrants d’innombrables exemples de stades intermédiaires. Je pense qu’il n’est pas déraisonnable d’espérer mettre au point prochainement des IA intermediaires ou « presque fortes » surpassant le niveau de l’intelligence globale de certains invertébrés. Je crains en revanche qu’on déchante sérieusement lorsqu’il s’agira d’égaler l’intelligence globale d’animaux supérieurs. Le goulot d’étranglement risque d’être le matériel et notamment la quantité de neurones artificiels requis ainsi que la consommation énergétique. À la fin, il sera peut être plus efficace d’avancer la recherche sur l’IA forte sur un matériel biologique. Il y a deja des papiers publiés sur l’utilisation de neurones biologiques et de l’ADN en informatique.

La création ne résulte pas forcément d’une intention ou volonté. Quelques découvertes et inventions sont dues à la sérendipité : https://fr.wikipedia.org/wiki/Liste_des_découvertes_et_inventions_liées_au_hasard

Des œuvres d’art peuvent également émerger d’un geste inconscient et parfois des solutions surgissent sans réflexion (flash, bonne nuit, extrapolation…)

La conscience de soi appartient aussi à certains animaux comme les grands singes, les dauphins, les pies et les éléphants :

https://www.sciencesetavenir.fr/animaux/grands-mammiferes/video-la-preuve-impressionnante-que-les-elephants-ont-conscience-de-leur-corps_112217

Enfin, envisager la transition particules/esprit sous l’angle de la biologie et de l’évolution importe peu sauf à vouloir reproduire le processus à l’animal. On pourrai alors apprendre à l’animal de passer du stade de la fabrication de l’outil (https://fr.wikipedia.org/wiki/Utilisation_d%27outils_chez_les_animaux) à la fabrication d’arme pour forcer sa conscience à extérioriser la mort et par conséquent découvrir l’esprit. Mais serait-ce éthique ?

Pour ce qui est d’avancer dans l’IA forte, les transistors permettent de simuler un neurone. Certes le rendement biologique est bien supérieur mais les supercalculateurs progressent. Ce qui importe c’est de comprendre la dualité matière/spirituel. Le spirituel émerge t-il de la matière ou est-il intrinsèque au cerveau ? Je pencherai plutôt pour le deuxième cas. Je le verrai comme quelque chose de virtuel, un arc-en-ciel cérébral en somme.

Pour avancer dans l’IA forte, il s’agit de reproduire le processus neuronal qui passe dans les différentes couches structurellement identique à un oignon. Il faut donc encapsuler l’IA faible dans l’IA forte.

Pingback: Une intelligence artificielle peut-elle être créative ? — Science étonnante #57 | JetBip

On parle bcp d’algorithme, mais qu’est ce que c’est exactement? Comment cela se programme? Quels critères cela prend et comment?

Pouvez vous faire un épisode là dessus, svp? Merci

Excellente vidéo comme d’habitude, donc merci !

Par contre j’aimerais aussi avoir une réponse à la question posée par Damien 🙂

Bonjour, peut on vraiment parler de créativité alors que toutes les applications présentées ne sont que des problèmes avec un nombre de solutions fini, donc de toutes façons n’importe quelle machine pourra toujours les explorer ou sélectionner toutes en fonction de la puissance du support informatique et de la qualité de l’algorithme.

La notion de créativité arrivera lorsque des situations non prévisibles au départ se manifesteront.

Bonjour,

Nouveau sur ce forum je voudrais d’abord vous dire combien j’apprécie les vidéos de Science Etonnante, claires et concises et souvent instructives même pour un chercheur expérimenté. Bravo David et continuez à nous étonner encore. Je n’ai pas trouvé de liste exhaustive des vidéos, d’où ma question: avez vous déja traiter le sujet de Natural Computing (algorithmes inspirés par des phénomênes naturels, comme l’évolution, les essaims particulaires etc..) ?

Pingback: Jouer au jeu des allumettes contre une machine ! — Pixees

Pingback: Une intelligence artificielle peut-elle être créative ? Le cas des jeux. (Echecs & Go) – David louapre – Phil-Dev Deeplearning